ECHOES24 Conference: Mit dem digitalen Echolot zu den Untiefen musikwissenschaftlicher Erkenntnis

Das Forschungsprojekt „Echoes from the Past: Unveiling a Lost Soundscape with Digital Analysis” (2023-2026), angesiedelt an der Universidade NOVA de Lisboa, untersucht die Musik des Mittelalters mit digitalen Methoden. Auf interdisziplinärem Terrain verspricht es somit neue Erkenntnisse für die historische Musikforschung und Musiktheorie, die Digital Humanities (Computational Musicology) und das Music Information Retrieval (MIR) gleichermaßen.

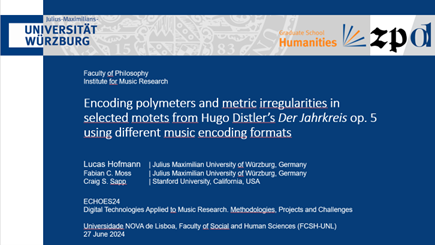

Teil des Projekts war die einmalig stattfindende Konferenz „ECHOES24“, auf der ich Ende Juni erste Ergebnisse meines Promotionsprojekts vorstellen durfte. Sie führte weltweit führende Wissenschaftler:innen des Forschungsbereichs, ebenso wie Promovierende, Early Career Scholars und Professor:innen in Lissabon zusammen, um über „Digital Technologies Applied to Music Research: Methodologies, Projects and Challenges“ zu diskutieren.

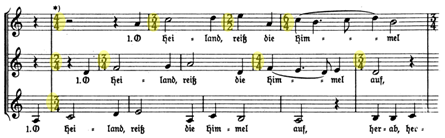

In meiner Promotion beschäftige ich mich im Rahmen einer digitalen Korpusstudie mit Polymetrik und metrischen Irregularitäten in den Kompositionen Hugo Distlers, Béla Bartóks und Paul Hindemiths. (Polymetrik nennt man – ganz allgemein – gleichzeitig auftretende, unterschiedliche Taktarten, siehe Abb. 1.) Darauf aufbauend möchte ich ein eigenes Bayessches Modell für Polymetrik entwickeln. Solche metrisch komplexen Strukturen werden in der aktuellen Forschung zur computergestützten Musikwissenschaft noch weitgehend außen vor gelassen, unter anderem da deren Modellierung und computergestützte Analyse bestehende Ansätze und Codierungsformate an ihre Grenzen führt. Mit meinem Forschungsvorhaben möchte ich diese Lücke schließen und mittels einer ergebnisoffenen Grundlagenforschung einen signifikanten Beitrag zur Analyse komplexer Musik, insbesondere des 20. Jahrhunderts, leisten. Daher interessierten mich explizit die auf der Konferenz behandelten Themenbereiche „Key challenges in applying digital technologies to music research” sowie „Music encoding”.

Herausforderungen bei der Codierung von Polymetrik

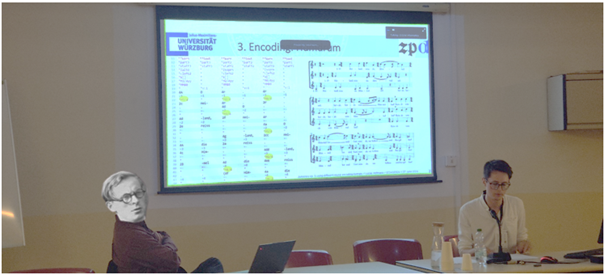

Für meine Promotion und beginnende wissenschaftliche Karriere stellte diese Konferenz ein wichtiges Sprungbrett dar. Dort konnte ich zum ersten Mal mein eigenes Forschungsprojekt in einem öffentlichen Vortrag international präsentieren. Explizit stellte ich die Möglichkeiten und Grenzen der Codierung von Polymetrik in verschiedenen Musikcodierungsformaten vor (Folien; Videomitschnitt, leider ohne Ton). Zu meiner Freude war mein Vortrag sehr gut besucht und das Publikum aufmerksam interessiert. Mein Befund, dass Polymetrik in den bestehenden Formaten MusicXML, MEI und Humdrum (noch) nicht originalgetreu codiert werden kann, überraschte die Anwesenden. An den drei Konferenztagen konnte ich mich darüber in vielen Gesprächen austauschen – deshalb wurden gerade die Kaffeepausen zu den wichtigsten Zeiten für mich. Wir haben auch schon gemeinsam erste Lösungsansätze diskutiert, die aufgrund des starken Alte-Musik-Fokus der Konferenz neben dem modernen Westlichen Notationssystem dankenswerterweise auch die Mensuralnotation einschlossen – ein vielversprechender Ansatz!

Musikforschung zwischen Gaga und Bioinformatik

Insgesamt hörte ich in den drei Tagen 15 Vorträge sowie zwei Keynotes, und besuchte zwei Workshops: in toto eine Tour d’Horizon durch die digitale Musikforschung. In Parallel Sessions fanden gleichzeitig Vorträge in den Bereichen „Digital Early Music“ und „Digital Musicology“ statt. Hier eine Auswahl:

Tillman Weyde (City, University of London) stellte kollaborative Tools in der Jazz-Forschung vor, die synergetisch Methoden des Music Information Retrieval (MIR) und des maschinellen Lernens kombinieren. Insbesondere besprach er seine JazzDAP Studien, die auf den bekannten Arbeiten zur Dig That Lick Database sowie dem Jazzomat Research Project aufbauen.

Das Warschauer Fryderyk-Chopin-Institut um Marcin Konik, Jacek Iwaszko und Craig Sapp stellte das beeindruckende Projekt „Polish Music Heritage in Open Access“ (siehe Polish Scores) vor: ein Online-Repositorium polnischer Musik aus sechs Jahrhunderten, das rund 25.000 Manuskripte und Partituren mit insgesamt einer halben Million Seiten Musik umfasst. Die digitalen Editionen enthalten Codierungen im Humdrum-Format, die mittels IIIF-Koordinaten mit den originalen Partiturseiten verbunden sind.

Andreas Waczkats (Göttingen) forscht zur Rekonstruktion des Klangs einer Londoner Orgel, auf der Georg Friedrich Händel einst spielte. Dem Klangideal nähert sich Waczkat mithilfe des Tools „SOUND“ (FU Berlin), das 3D Sound-Daten verwendet, sowie der VR-Anwendung „Virtual Acoustics“ (RWTH Aachen).

Maria Navarro Cáceres (Salamanca) untersuchte in 20.000 irischen und spanischen volkstümlichen Melodien die Verwendung verschiedener Kirchenmodi. Interessant: Vor allem im spanischen Raum ist Phrygisch sehr beliebt!

Tim Eipert (Würzburg) und Francisco Camas (Madrid) verwendeten in Ihrer Forschung zu mittelalterlichen Tropen unabhängig voneinander bioinformatische Methoden der Phylogenese, um die Provenienz verschiedener Gesänge mit ihren musikalischen Stilen abzugleichen. Daraus ließ sich eine „Stammesgeschichte“ verschiedener mittelalterlicher Gesänge ableiten. Insbesondere diese beiden Forschungsprojekte stießen auf großes Interesse, da hier sowohl die Integration in die historische Musikforschung als auch der erwartete Erkenntnisgewinn sehr vielversprechend ist.

Ganz allgemein war der Wunsch nach Interdisziplinarität im Plenum deutlich spürbar. In diesem Sinne warb Cory McKay (Marianopolis College) für mehr Kommunikation und Offenheit bei Kooperationen zwischen der Musikwissenschaft und der Informatik bzw. dem MIR. Seinem Vortrag stellte er die methodologisch entscheidende Frage voran, „how to make musicological sense out of computer data“. Neben der gründlichen Vor- und Aufbereitung musikalischer Daten, um Biases zu vermeiden, trügen vor allem Visualisierungen zum Verständnis bei.

Adam Knight Gilbert (USC, Los Angeles) entwickelte gemeinsam mit Andrew Goldman (Indiana University) den GaGA-(Gilbert-and-Goldman)-Algorithm, mit dem sie Symmetrien in Kontrapunktwerken des 15. Jahrhunderts identifizieren können. Auf diese Weise untersuchten sie verschiedene Formen musikalischer Palindrome („Inversodrome“, „Crabindrome“) in Chansons von Gilles Binchois sowie in Messen und Motetten Johannes Ockeghems. Sie stellten die Frage in den Raum, inwieweit solche Symmetrien kompositorisches Spiel oder kontrapunktisches Derivat sind.

Keynotes: Schon viel erreicht und noch mehr zu tun

Besonders beeindruckend war die abendliche Keynote von Ichiro Fujinaga (McGill University), der seit 40 Jahren Pionierarbeit auf dem Gebiet der Optical Music Recognition (OMR) leistet. Humorvoll veranschaulichte er die Errungenschaften in diesem Bereich und ermutigte, die aktuellen Herausforderungen anzugehen. Er warb insbesondere für das Konzept der „Mechagogy“, dem Machine Teaching als Fähigkeit, Computer und Künstliche Intelligenzen richtig zu „erziehen“ und somit leistungsstärker und lösungsorientierter zu machen. An dieses Konzept konnten auch die Kunstsoziologen Denise Petzold und Jorge Diaz Granados (Maastricht) anschließen, die zur Diskussion über die Frage anregten, ob digitale Technologien als Musikinstrumente angesehen werden sollten.

In der zweiten Keynote mit dem Titel „Sustaining Digital Musicology“ plädierte Jennifer Bain (Dalhousie University) für mehr Kooperation innerhalb der Musikforschung, um Forschungsdaten langfristig erhalten zu können. Mit erschreckenden Zahlen aus den vergangenen drei Jahren warnte sie vor Datenverlust durch Cyberattacken. Das Rechenzentrum der Dalhousie University etwa (mit ihren 20.000 Studierenden) blockiert täglich 800.000 Spam-Mails. Die British Library arbeitet seit einem verheerenden Hacker-Angriff vergangenen Oktober immer noch an der Wiederherstellung wertvoller Daten. Leider seien es häufig DH-Projekte, die den Weak Link ins Unisystem darstellen, da ältere Online-Projekte oftmals keine Updates mehr durchlaufen. Der Nachhaltigkeit solcher Projekte abträglich seien zudem schlechte Dokumentation und ein erschwerter Zugang zu Fördermitteln. Was also tun? Zielführend seien gemeinsame, interdisziplinäre Projekte, die auf bestehenden Tools aufbauen, und vor allem gemeinsame Metadaten-Standards innerhalb der Community. Jennifer Bain schloss zuversichtlich: „The future of Digital Musicology looks bright. Let us be more intentional.”

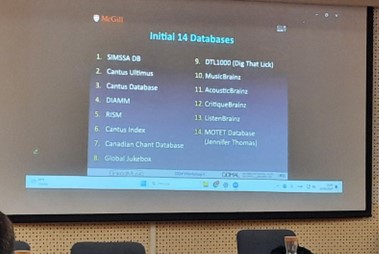

Ein solches verheißungsvoll-intentionales Projekt stellte Ichiro Fujinaga abschließend in einem interaktiven Workshop vor: LinkedMusic. Dessen Ziel ist es, von einer Website aus in verschiedenen Musikdatenbanken suchen zu können, und zwar ausdrücklich auch in anderen Sprachen als Englisch. Die Herausforderung dabei: Die 14 verbundenen Datenbanken haben 14 inkompatible Datenbankstrukturen. Integrierte Bestandteile von LinkedMusic sind u. a. Linked Open Data, Semantic Web (für Interoperability und Data Integration), der RDF-Standard, die SPARQL Language sowie OpenRefine zur Bereinigung und Konvertierung von Daten.

Quintessenz

Was nehme ich von der Konferenz mit? Einen vollen Kopf, eine Liste an Mailadressen, viele offene Google-Tabs und noch mehr offene Fragen, etliche Forschungsideen und sogar schon Angebote für Forschungsaufenthalte an der Stanford University und der McGill University. In jedem Fall waren meine Erlebnisse auf der ECHOES24 überaus positiv, vor allem geprägt durch das angenehme Konferenzklima (sowohl zwischenmenschlich als auch meteorologisch). Dazu beigetragen haben allem voran das ehrliche Interesse der Teilnehmenden und die wertschätzende Feedback-Kultur, die in dieser Form insbesondere für Promovierende wünschenswert ist.

Der Autor dankt dem DHd-Verband für die Ermöglichung der Konferenzteilnahme durch das Reisekostenstipendium für DH-nahe Tagungen (Sommer 2024).

Kontakt: lucas.hofmann@uni-wuerzburg.de

[1] Hugo Distler, „O Heiland, reiß die Himmel auf“, in: Der Jahrkreis op. 5, Kassel 1933, S. 8, Beginn.

Kommentar schreiben